在2020年,神经网络设计已进入一个高度专业化与系统化的阶段。随着硬件性能的提升、数据规模的扩大以及研究范式的演进,设计一个高效、可扩展且实用的神经网络需要综合考虑多个维度的因素。以下是2020年神经网络设计的关键策略与步骤,旨在为从业者提供清晰的网络策划指南。

一、明确任务目标与约束条件

设计之初,首要任务是明确定义模型需要解决的问题(如分类、检测、生成等),并评估可用资源,包括计算力(GPU/TPU)、存储空间、数据集规模与质量、以及部署环境(云端、边缘设备或移动端)。这些约束将直接影响网络架构的选择与优化方向。

二、架构选择:主流模型与定制化

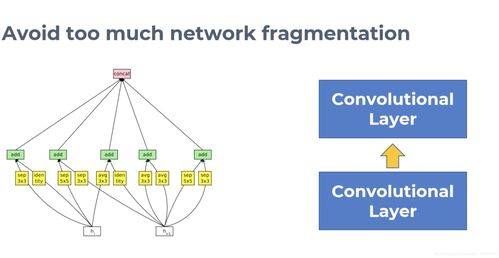

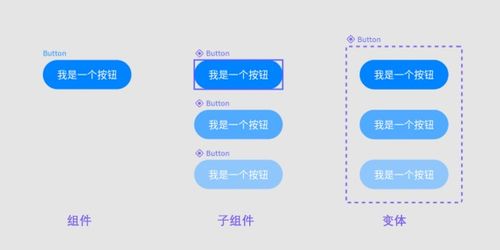

2020年,Transformer和高效卷积网络(如EfficientNet)成为两大主流架构。对于视觉任务,EfficientNet通过复合缩放方法平衡深度、宽度和分辨率,在精度与效率间取得优异平衡;对于序列任务(如NLP),Transformer及其变体(如BERT、GPT)凭借自注意力机制显著提升了性能。设计时可根据任务需求选择预训练模型进行微调,或基于现有模块(如残差块、注意力头)构建定制化网络,同时注重模块的轻量化设计以降低计算开销。

三、数据策略与增强技术

数据质量直接影响模型泛化能力。2020年,除了经典的数据增强(如旋转、裁剪、色彩调整)外,自动增强技术(如AutoAugment)和半监督学习(利用未标注数据)成为提升性能的关键。针对类别不平衡问题,可采用重采样或损失函数加权(如Focal Loss)来优化训练过程。

四、训练优化与正则化

训练过程中,优化器选择(如AdamW、LAMB)和学习率调度(如余弦退火)对收敛速度与稳定性至关重要。正则化方面,除了Dropout和权重衰减外,标签平滑(Label Smoothing)和随机深度(Stochastic Depth)被广泛用于防止过拟合。分布式训练与混合精度计算则能加速大规模模型的训练。

五、评估与迭代

设计网络时需建立多维评估指标,不仅关注准确率、召回率等传统指标,还需考虑推理速度、模型大小和能耗。使用验证集进行超参数调优(可通过网格搜索或贝叶斯优化),并利用消融实验分析各组件贡献。迭代过程中,关注模型的可解释性(如通过特征可视化)以排查潜在偏差。

六、部署与维护策略

2020年,模型部署趋向于端到端流水线化。使用框架(如TensorFlow Serving、ONNX)将模型转换为轻量格式(如量化、剪枝),以适应边缘设备。持续监控模型在生产环境中的性能,建立数据反馈循环,以便定期重新训练与更新。

2020年的神经网络设计强调全链路策划:从任务分析到架构创新,从数据工程到训练优化,最终实现高效部署。随着AutoML和神经架构搜索(NAS)技术的发展,自动化设计逐渐普及,但人工经验与领域知识仍是不可替代的核心。通过系统化策略,开发者能够构建出既强大又实用的神经网络解决方案,应对日益复杂的现实挑战。